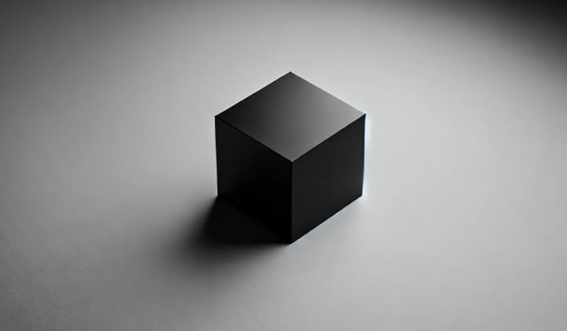

La caja negra: lo opaco en IA.

En inteligencia artificial, la “caja negra” es un término que describe modelos complejos cuyo funcionamiento interno es difícil o imposible de entender para los humanos.

El concepto de opacidad está directamente relacionado con la caja negra. Un modelo es opaco cuando no es transparente y resulta complicado para un ser humano comprender por qué tomó una decisión específica o llegó a una conclusión determinada. La opacidad suele ser una característica de modelos de aprendizaje automático muy complejos, como las redes neuronales profundas. Esto contrasta con los modelos más simples, como los árboles de decisión, que son más transparentes y se consideran “cajas blancas” porque es más fácil seguir el camino de sus decisiones.

El fenómeno de la caja negra surge principalmente por dos razones:

- Complejidad del modelo: Algunos modelos de IA, especialmente los que utilizan aprendizaje profundo, tienen miles o incluso millones de parámetros que interactúan de formas no lineales y difíciles de rastrear. Es casi imposible que una persona analice y entienda cada uno de estos parámetros y sus conexiones.

- Complejidad de los datos: La información de entrada puede ser tan masiva y compleja que la relación entre los datos de entrada y la decisión final del modelo no es evidente a simple vista.

La falta de transparencia en los modelos de IA presenta varios riesgos, especialmente en campos de decisiones sensibles. Aquí hay algunos ejemplos:

- Sesgos: Un modelo de IA opaco podría tomar decisiones sesgadas sin que nadie sepa por qué. Por ejemplo, un algoritmo de contratación que automáticamente discrimine a ciertos candidatos por su género o raza.

- Toma de decisiones sin intervención humana. La falta de transparencia en el modelo hace que sea difícil asignar esta responsabilidad.

Para enfrentar el problema de la caja negra, ha surgido el campo de la IA explicable (XAI, por sus siglas en inglés: Explainable AI). La XAI busca crear modelos de IA que no solo sean precisos, sino también transparentes y comprensibles para los humanos.

Algunas técnicas de XAI incluyen la visualización de datos, la simplificación de modelos complejos y la creación de herramientas que “abren” la caja negra, permitiendo a los expertos y al público entender cómo se llega a una conclusión.

No obstante, esta característica de la IA, su opacidad, nos orienta a que la forma de trabajo con la IA hoy tiene que ser colaborativa.

En Psicotécnicos Net, atentos a las posibilidades de la IA para evaluar personalidad y talento, nos orientamos a encontrar formas de trabajo colaborativo con la IA, atendiendo a sus posibilidades y sus limitaciones.